Vokinesis : instrument de contrôle suprasegmental de la synthèse vocale

Systèmes d’externalisation vocale ne faisant pas usage d’une tablette graphique

Machine de Von Kempelen

Figure 1.1 – Machine parlante de Von Kempelen [Von Kempelen 1791]. La boite des articulateurs doit être reliée à la sortie du soufflet. L’anche, qui modélise les plis vocaux, se trouve à l’intérieur de cette boîte. Le premier système de contrôle performatif de la voix artificielle, la machine parlante de Von Kempelen, est un système mécanique rendu publique en 1791 à travers le livre [Von Kempelen 1791]. C’est un modèle mécanique de l’appareil vocal qui permet de produire une voix artificielle contrôlée par des gestes (Figure 1.1). Chapitre 1. Introduction Les poumons sont modélisés par un soufflet, les plis vocaux par une anche et les articulateurs par un jeu d’actionneurs, non détaillés sur la figure. Le contrôle s’effectue avec un bras posé sur le soufflet et les deux mains à l’intérieur de la boite. Le soufflet, pressé par le bras, crée un flux d’air, et l’anche vibre. Les deux mains agissent ensuite sur les actionneurs pour moduler le son de l’anche et produire des phonèmes. Ce système a démontré son succès pour la prononciation de mots complexes, faisant intervenir des groupes de plusieurs consonnes consécutives, mais les utilisateurs ne semblent pas dépasser la longueur du mot. Nous terminerons sa présentation par une citation de son auteur : « Je ne donne pas […] la machine parlante […] comme un ouvrage bien achevé, et qui imite parfaitement la parole, mais j’ose me flatter, sans trop d’amour propre, que toute imparfaite qu’elle est, elle donne du moins de bons principes pour en construire une plus parfaite. […] Puisse-t-il à la fin de ce siècle si fertile en découverte, se trouver une main de maître, qui porte cette découverte […] au plus haut degré de perfection. » Plus de deux siècles plus tard, ce degré n’a sans doute pas encore été atteint. Nous montrerons par la suite que le vœu de Von Kempelen est aujourd’hui encore entendu, bien qu’en raison de la maîtrise de l’électricité, la voie choisie pour tenter de l’exaucer soit devenue bien différente de celle qu’il aurait sans doute imaginée.

Voder

Figure 1.2 – Utilisation du Voder [Dudley et al. 1939] : les mains contrôle l’articulation et le voisement, le pied contrôle la hauteur. 5 Il a fallu attendre le XXe siècle et une excellente maîtrise de l’électricité avant que ne fût inventée une nouvelle machine parlante. Le Voder (Voice Operation DEmonstrator) a été développé en 1939 par [Dudley et al. 1939] dans les laboratoires Bell. Son principe de contrôle est représenté figure 1.2. C’est un synthétiseur à formants qui possède une source périodique pour les sons voisés, une source bruitée pour les sons fricatifs, et un jeu de 10 filtres passe-bande à fréquence de coupure et à largeur de bande fixes, qui servent à modéliser les formants. L’opératrice peut contrôler l’état de voisement grâce à la barre qui se trouve sous son poignet gauche. Si la barre est relâchée, la source non-voisée est active, et son amplitude sera diminuée au fur et à mesure que la pression sera augmentée. Inversement, l’amplitude de la source voisée augmentera avec la pression. L’articulation de la plupart des phonèmes se contrôle avec les touches blanches : chaque touche permet de contrôler l’amplitude d’un des dix filtres passe-bande. Si toutes ces touches sont relâchées, l’amplitude de chaque filtre est nulle, et aucun son n’est produit. Les trois touches noires permettent de déclencher les plosives. Enfin, l’intonation est contrôlée par une pédale. Selon l’auteur, il a fallu aux opératrices environ un an d’entraînement soutenu pour être en mesure d’avoir une conversation simple dont l’intelligibilité et le naturel laissaient souvent à désirer. La vidéo 1 fournit une démonstration de ce système.

SPASM

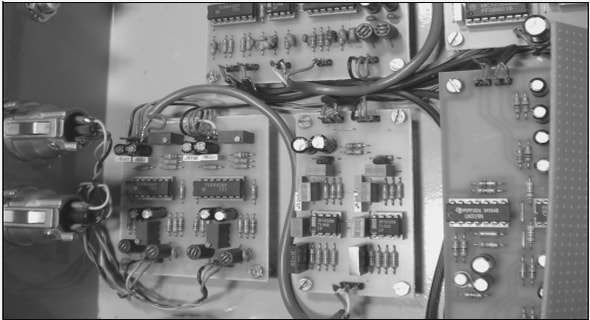

Figure 1.3 – Fenêtres principale du SPASM [Cook 1991] 1. https://youtu.be/0rAyrmm7vv0 Chapitre 1. Introduction Plus de cinquante ans, et des capacités de calcul informatique assez puissantes, furent nécessaires avant de voir apparaître le système SPASM (Singing Physical Articulary Synthesis Model) [Cook 1993]. Comme son nom l’indique, le système de synthèse de ce logiciel est basé sur un modèle articulatoire. Les paramètres contrôlables en temps-réel sont la hauteur, le vibrato (fréquence, amplitude et taux d’aléa), l’amplitude de la source de bruit, sa position d’injection dans le conduit vocal, l’aire de chacune des huit sections qui composent le conduit vocal et l’ouverture du voile du palais. Tous ces paramètres peuvent être retrouvés dans la Figure 1.3, qui présente les fenêtres principales du logiciel. Il est clair que la seule utilisation de la souris et du clavier de l’ordinateur n’offre pas assez de liberté pour un contrôle temps-réel simultané de tous ces paramètres. Pour ce qui concerne l’articulation, l’auteur propose une solution qui consiste à interpoler jusqu’à six différentes formes du conduit vocal avec un seul paramètre. Ensuite, il est possible d’assigner un contrôleur MIDI à n’importe quel paramètre contrôlable en temps-réel. Par défaut, le logiciel assigne la hauteur aux notes d’un clavier MIDI, l’effort vocal à l’aftertouch, et l’interpolation des formes du conduit vocal à la roue de modulation (une explication du fonctionnement du protocole et des interfaces MIDI sera fournie dans la section 4.2). L’auteur a par la suite cherché à développer de nouvelles interfaces mieux adaptées au contrôle expressif de l’instrument vocal [Cook 2005], avec comme idée principale de lier l’effort vocal à la force d’un souffle, et de trouver des manières de contrôler la hauteur et l’articulation de manière continue. Ainsi apparurent les Squeezevoxen (des accordéons augmentés), le VOMID (Voice-Oriented Melodica Interface Device, un mélodica augmenté) et le COWE (Controller, One With Everything, une interface composée d’un capteur de souffle, de capteurs de pression, de boutons et d’accéléromètres). Des exemples audio de signaux synthétisés par SPASM peuvent être écoutés sur cette page 2

Glove Talk

le Glove Talk est un système de contrôle temps-réel d’un synthétiseur à formants [Rye & Holmes 1982]. La voix de synthèse est contrôlée par une pédale d’expression et par des gants augmentés de capteurs de pression, d’un accéléromètre et d’un gyromètre. Le principe consiste à apprendre à l’ordinateur, à travers un réseau de neurones, une association de gestes et de sons. Dans sa première version [Fels & Hinton 1993], les gestes permettent de contrôler les mots d’un dictionnaire. Dans sa seconde version [Fels & Hinton 1998], les gestes permettent de contrôler des phonèmes, et donc de prononcer n’importe quelle phrase, offrant ainsi la possibilité d’avoir une véritable conversation. La Figure 1.4 montre son auteur en train de parler à l’aide de ce système. La hauteur du signal de synthèse est contrôlée par la hauteur de sa main droite. Cette même main permet également de contrôler l’articulation des voyelles de manière continue grâce à sa position dans le plan horizontal. Les consonnes sont contrôlés par les deux mains : différentes positions du pouce sur les autres doigts sélectionnent différentes consonnes. La force de voix est contrôlée 2. Figure 1.4 – Utilisation du Glove Talk par S. Fels. par une pédale d’expression. Selon l’auteur une centaine d’heures d’entraînement sont nécessaires avant d’être capable de prononcer un discours intelligible. La vidéo 3 le confirme, et présente même une étape de conversation, mais elle montre tout de même que le naturel de la synthèse est assez peu convainquant, et que les gestes à accomplir sont assez complexes.

1 Introduction |