Navigation visuelle d’un robot mobile dans un

environnement d’extérieur semi-structuré

Acquisition et reproduction d’images couleur

Introduction

Les caméras sont l’un des plus importants éléments dans la chaîne d’acquisition d’images, leurs propriétés et caractéristiques sont essentielles au bon déroulement du processus de perception en vision robotique. Spécifiquement, notre intérêt est focalisé sur les capteurs matriciels mono-CCD pour l’acquisition d’images numériques couleur . Dans ce chapitre nous allons présenter les diverses problématiques liées à la reproduction de la couleur et les méthodes implémentées pour obtenir des images couleur de bonne qualité. Ces méthodes ont été intégrées dans le système embarqué sur le robot Dala pour traiter les images acquises par des caméras IEEE1394 de marque Micropix C-1024, mais nous les avons aussi appliquées à des images acquises par plusieurs appareils photos numériques. Des fonctions comme le démosa¨ıquage ou demosaicking [Kimmel 99], le calibrage automatique du point blanc (ou balance des blancs), l’adaptation chromatique, des transformations en ligne pour obtenir une invariance à l’illumination, la correction gamma … sont appliquées aux images couleur avant traitement. Connaître précisément ces fonctions et les optimiser sont des étapes fondamentales qui vont nous permettre d’exploiter des images couleur de qualité optimale, pour la reconnaissance d’objets et pour contrôler le déplacement d’un robot mobile en milieu naturel. De plus, pendant l’exécution d’une de ces fonctions, la couleur de l’éclairage pour une scène peut changer : la couleur des surfaces présentes dans la scène va alors changer dans la même proportion. Ce décalage de couleur va être responsable de problèmes d’instabilité dans les descripteurs utilisés dans le système de vision. Evidemment, sans la stabilité colorimétrique de ces descripteurs, la plupart des applications impliquant la couleur ( e.g., systèmes de reconnaissance d’objets [Swain 91], photographie numérique [Jacobson 00], etc. ) vont être négativement affectées par les moindres variations d’illumination . On pourrait se demander pourquoi les performances du système visuel de l’homme ne sont pas affectées par de telles variations. Pour le savoir, la communauté scientifique a essayé de mesurer expérimentalement la constance de couleur chez l’humain ; mais les mécanismes de la vision humaine menant à la constance des couleurs restent encore sans explication satisfaisante . Pourtant, à l’intérieur de notre système visuel, chacun des photorécepteurs de la rétine est sensible à une seule gamme de longueur d’onde ; une seule composante couleur est échantillonnée à chaque position spatiale ; les caméras .

Acquisition et reproduction d’images couleur mono-CDD utilisent ce même principe en fournissant uniquement une composante colorimétrique par pixel. Ce type d’échantillonage correspond à un multiplexage spatial de l’information couleur dans une image . Dans les sections suivantes, nous décrirons tout d’abord les caméras que nous avons utilisées, toutes équipées de mosa¨ıque Bayer. Nous décrirons et comparerons les méthodes existantes pour reconstituer une image couleur à partir de cette mosa¨ıque. Puis, nous traiterons du calibrage chromatique, connu sous le nom Balance des blancs.

Acquisition des images couleur

L’acquisition d’une image couleur peut se faire à l’aide de plusieurs types de caméras. Dans les travaux qui ont précédé les notres dans notre groupe de recherche, R.Murrieta utilisait des caméras analogiques, soit des caméras mono-CCD délivrant une image vidéo au format PAL, soit des caméras tri-CCD qui donnaient directement les trois images au format RGB. Des cartes d’acquisition adaptées permettaient de récupérer sur le calculateur hˆote, les trois plans image Rouge, Vert et Bleu. Rappelons que du fait du standard vidéo, la résolution d’une image analogique est limitée à 591 lignes; le nombre de pixels échantillonés par ligne dépend de la taille de la matrice CCD et du numériseur. Avec les derniers numériseurs, R.Murrieta exploitait des images composées de 590 lignes de 768 pixels. L’ère des caméras analogiques est révolue : nous n’avons exploité que des caméras CCD numériques. La limite sur la résolution des images est maintenant définie par la taille de la matrice CCD et par la vitesse de transmission de la liaison entre caméra et calculateur hˆote. La technologie évolue très rapidement dans l’un et l’autre domaine, du fait des applications grand public : photo numérique (le moindre appareil a maintenant une matrice de 5Mega pixels), et Internet (pour accélérer les vitesses des liaisons entre modems ADSL et calculateur…). Dans notre cas, – nos caméras sont connectées par bus série Firewire ou IEEE 1394, pour lesquelles les cartes interface sont déj`a integrées sur les calculateurs en standard. Ce bus Firewire supporte des vitesses de transfert de l’ordre de 400Mb/s (soit 50Mo/s). L’un des avantages du FireWire est le branchement à chaud ; il constitue ainsi, l’interface idéal pour les équipements audio/vidéo numériques. – les caméras numériques industrielles ont une résolution limitée par rapport aux appareils photo grand public, puisque typiquement, elles fournissent des images de 1M pixels. Nous n’exploitons aucun algorithme de compression d’images, ni aucun traitement interne à la caméra, cela pour avoir une totale maîtrise sur la qualité des images que nous allons exploiter. Nous n’avons pas testé les caméras exploitant les deux autres protocoles qui existent à ce jour pour des caméras numériques : – les caméras USB, souvent caméras bas cout de type WebCam ou très bas cout, ˆ comme les caméras construites par STMicroelectronics et intégrées dans les téléphones portables : dans notre groupe, les travaux sur la reconnaissance gestuelle ou le suivi de visages, exploitent de tels capteurs. – les caméras Camera Link ou LVDS, qui au contraire, sont souvent exploitées pour des applications critiques (contrˆole-commande, acquisition d’images haute résolution à plus de 30Hz …) : dans notre groupe, le projet BODY SCAN (modélisation du corps humain) a fait usage de telles caméras.

Acquisition des images couleur

Les caméras tri-CCD numériques n’étaient pas disponibles lorsque nous avons commencé nos travaux. Nous avons donc exploité uniquement des caméras mono-CCD, décrites dans la section suivante.

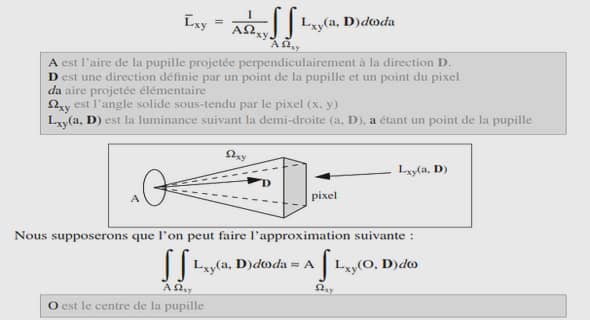

Caméras couleur fondées sur une mosaïque Bayer

Les capteurs CCD captent la lumière sur les petits photosites situés à leur surface. Les photosites sont organisés en rangées et colonnes, le plus souvent sur une matrice avec un passage vertical entre chacun d’entre eux de manière à ce que les charges électriques puissent être transférées de manière synchrone vers un registre. Pour des raisons techniques, ces détecteurs ne peuvent capter individuellement qu’une seule longueur d’onde à la fois en un photosite donné. La méthode la plus répandue pour obtenir des images couleur avec un capteur mono-CCD [Zomet 02] consiste à placer devant chaque cellule sensible, un filtre du type CFA11 , de telle sorte que chaque photosite du capteur CCD ne perçoit qu’une des trois composantes spectrales, généralement Rouge, Verte et Bleue (voir figure 2.1). Les pixels sont alors disposés selon un matriçage dit en quinconce. Pour la mosaique d’une matrice colorée, le filtre le plus utilisé est le 3-chromatique RGB, bien que d’autres soient aussi disponibles : le 3-couleurs complémentaires YeMaCy, le système à 4-couleurs ou` la quatrième couleur est le blanc ou une autre couleur d’une sensibilité spectrale décalée [Alleysson 02]. Bien que l’utilisation de plus de 3 composantes colorimétriques, dans la fabrication de capteurs CCD, semble donner plus d’informations spectrales sur la scène, la corrélation implicite entre les composantes de couleur réduit son utilité en pratique.

Avant-propos |